Le discours dominant sur l’IA est un discours de croissance. Plus de productivité, plus de vitesse, plus de parts de marché, plus de chiffre d’affaires. Les usages mis en avant sont presque toujours des cas d’expansion : générer plus de contenu, traiter plus de leads, explorer plus de code, couvrir plus de marchés.

Ce récit est cohérent dans un monde d’abondance : énergie bon marché, capital disponible, main-d’œuvre qualifiée accessible. Il devient fragile dans un monde contraint.

Or, l’Europe est justement en train d’entrer dans un monde contraint (si ce n’était pas déjà le cas).

Un contexte qui change le calcul

Le constat est avant tout structurel. L’Europe cumule plusieurs fragilités simultanées : une dépendance énergétique extérieure qui s’est révélée au grand jour depuis 2022, une démographie qui comprime le marché du travail sur une génération, des contraintes de défense et d’approvisionnement qui réintroduisent le politique dans des chaînes logistiques qu’on croyait purement économiques.

Le résultat n’est pas un effondrement. C’est quelque chose de plus insidieux : un monde plus volatil, plus discontinu, plus politique, un monde où les hypothèses de stabilité sur lesquelles reposaient les modèles économiques deviennent moins fiables.

Ce contexte change radicalement ce qu’on devrait attendre de l’IA, et donc où investir.

La fragilité silencieuse du digital

Pour comprendre pourquoi, il faut d’abord regarder ce que le digital a fait aux organisations. En 30 ans, il a structurellement augmenté leur productivité tout en éliminant les redondances (tout ce qu’un système garde au-delà du strict nécessaire pour fonctionner en conditions normales), les frictions, les délais, les stocks tampons. C’est la tendance de fond : optimiser les flux en supprimant tout ce qui ne crée pas de valeur immédiate.

Le problème de cette logique est qu’elle confond efficacité et solidité. Optimiser pour l’efficacité, c’est optimiser pour la fragilité : moins de marge de manœuvre, moins de redondance, plus grande sensibilité aux ruptures. La pandémie ou les récents évènements géopolitiques l’ont démontré de façon spectaculaire : les chaînes d’approvisionnement les plus optimisées ont été les premières à s’effondrer, précisément parce qu’il n’y avait plus d’amortisseur.

La plupart des organisations ont fait cet arbitrage sans le voir. Elles ont numérisé pour performer, pas pour tenir.

3 états, 3 directions

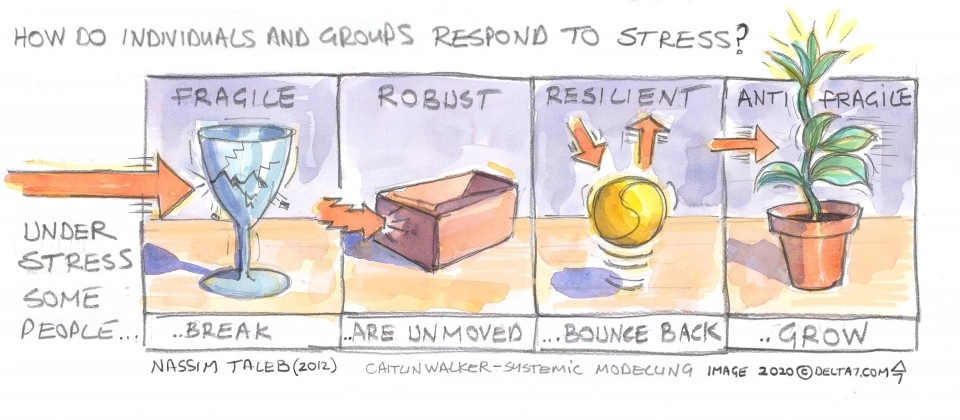

Face à un monde plus volatile, il existe 3 postures différentes et qui ne pointent pas dans la même direction.

- La robustesse, c’est la capacité à encaisser un choc sans plier.

- La résilience, c’est la capacité à revenir à l’état initial après un choc.

- L’antifragilité, le concept développé par Taleb, va plus loin : un système antifragile tire profit de la volatilité, il se renforce quand les conditions se dégradent.

Ces 3 objectifs impliquent des choix de conception opposés. Un système robuste est conservateur et redondant. Un système résilient est modulaire et réversible. Un système antifragile est conçu pour l’optionnalité : il préserve la capacité à bifurquer, maintient un faible coût fixe, distribue intelligemment ses sources de revenus et se protège sévèrement contre le downside (la perte potentielle si les choses se passent mal) tout en restant exposé asymétriquement à l’upside (le gain potentiel si les choses se passent bien.).

Dans le meilleur des cas, la question qui en découle pour les investissements IA est directe : est-ce que les systèmes que vous déployez vous rendent plus robustes, plus résilients, ou plus antifragiles face à un monde qui se contracte ? Dans le pire des cas, dans quelle mesure ces systèmes vous rendent plus fragiles ?

Déployer n’est pas cristalliser

Prenons un exemple concret : celui d’un LLM propriétaire centralisé, accessible via API, hébergé aux États-Unis (en sachant que 80% de l’infra IA européenne repose sur des fournisseurs américains, l’exemple ne parait pas aberrant 🙃). (source : Brussels Signal)

Ce modèle est commode, performant, et souvent le choix par défaut. Il est aussi structurellement fragile dans le contexte qui s’annonce. La dépendance est multiple : à un fournisseur qui fixe ses prix unilatéralement et peut déprécier un modèle sur lequel vous avez construit vos workflows, à une infrastructure que vous ne contrôlez pas, à une connectivité réseau qui n’est pas garantie en environnement industriel, et à un contexte géopolitique où des restrictions d’accès ne sont plus un scénario théorique.

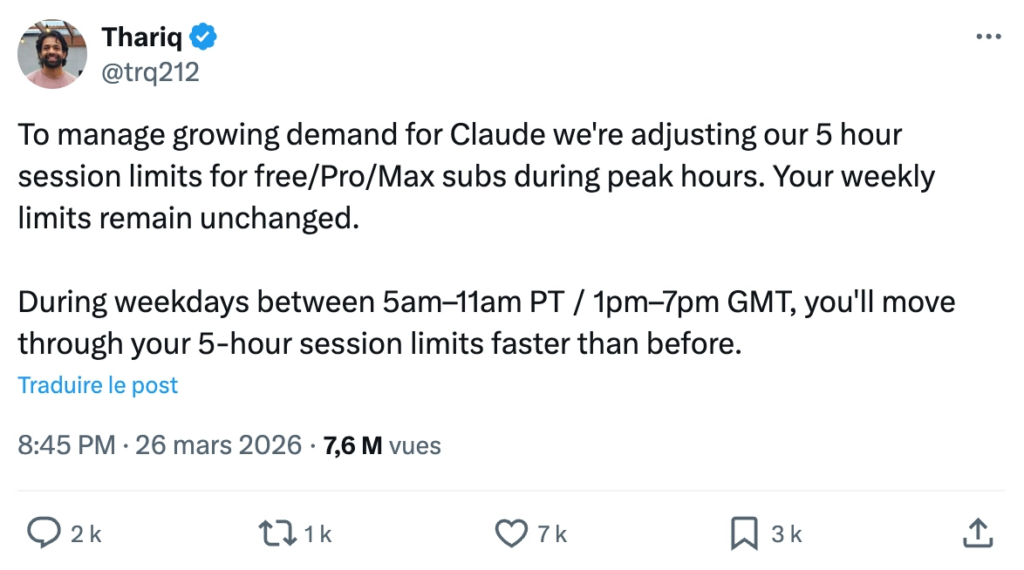

Exemple récent (mars 2026) : Anthropic, société qui commercialise et développe “Claude”, a mis en place un système d’heures pleines/heures creuses sur l’utilisation de ces outils et a réduit l’intensité d’utilisation par période.

À noter que ce n’est pas une critique des grands modèles, mais plutôt une description de leur profil de risque. Un actif dont vous dépendez sans le contrôler, dont le coût varie selon des décisions extérieures, et qui cesse de fonctionner quand la connectivité est absente, est un actif fragile.

À l’opposé, une architecture antifragile ressemble à quelque chose de différent, comme par exemple : des modèles open-source déployés localement pour les workflows critiques, une optionnalité vers le cloud pour les tâches moins sensibles, une séparation claire entre ce qui doit rester souverain et ce qui peut être délégué. Faible coût fixe, pas de dépendance à un fournisseur unique, capacité de déploiement en edge là où la connectivité est intermittente.

Cette réflexion sur l’infrastructure est nécessaire mais elle ne suffit pas. Dans un monde contraint, la valeur n’est pas dans le choix d’infrastructure. Elle est dans le produit et dans le savoir-faire qu’il cristallise. Une architecture souveraine qui ne sert qu’à reproduire un usage générique ne protège pas davantage qu’une dépendance au cloud. Ce qui compte, c’est ce que le produit encapsule : une logique métier, une connaissance rare, un processus de décision que l’organisation ne peut pas se permettre de perdre ni d’externaliser.

Le critère qui change tout

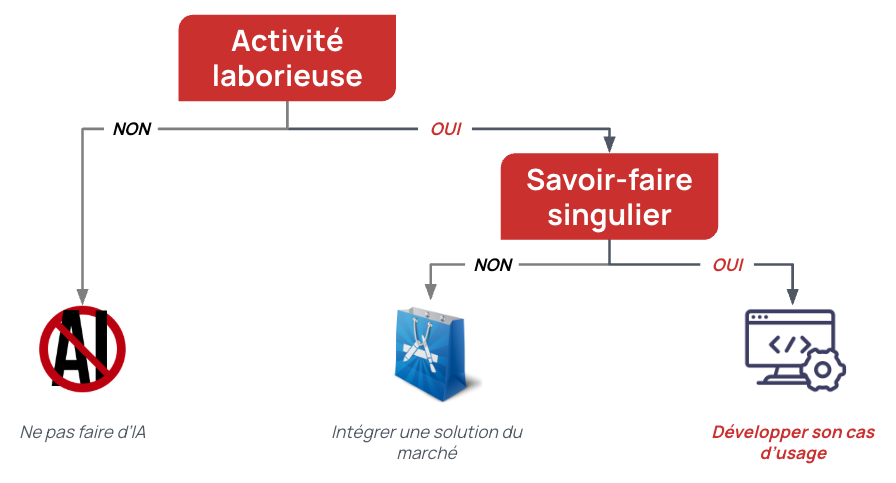

Il existe un test simple pour discriminer un investissement IA défendable d’un investissement exposé dans un monde contraint.

Un bon investissement IA dans ce contexte est celui dont le ROI (return on investment / retour sur investissement) s’améliore quand les contraintes augmentent.

Quand l’énergie coûte plus cher, les systèmes qui réduisent la consommation énergétique créent davantage de valeur. Quand la main-d’œuvre qualifiée se raréfie, les systèmes qui augmentent l’expertise rare créent davantage de valeur. Quand les erreurs coûtent plus cher parce que les matières premières sont chères, parce que les marges sont comprimées, parce que la réglementation se durcit, les systèmes qui réduisent la non-qualité créent davantage de valeur.

Parmi toutes ces ressources, le savoir-faire est sans doute la plus contrainte et la moins visible. Dans les secteurs de pointe comme la santé ou l’industrie le goulot n’est pas l’accès au capital ni même à l’énergie. C’est l’expert rare qui part en retraite sans passation de compétences, le professionnel surchargé dont le diagnostic mobilise trois semaines de planning, le spécialiste que le marché ne forme plus en nombre suffisant. Ce savoir-faire est le véritable goulot. Une IA qui le capte, le structure et le démultiplie est, par construction, antifragile : sa valeur augmente précisément quand cet expert se raréfie.

Ce test est l’inverse de la logique de croissance. Un investissement IA optimisé pour l’abondance crée de la valeur en ajoutant : plus d’output, plus de vitesse, plus de couverture. Il repose sur des hypothèses de coûts stables et d’accès facile aux ressources. Quand ces hypothèses se dégradent (et a priori, elles se dégradent actuellement), son ROI se dégrade avec elles.

Un investissement IA optimisé pour la contrainte crée de la valeur en comprimant : moins de matière gâchée, moins de temps perdu, moins d’erreurs, moins de dépendance à quelques experts seniors. Son ROI s’améliore mécaniquement quand les ressources deviennent plus rares.

Les secteurs qui passent ce test

Deux secteurs (parmi d’autres) illustrent cette logique avec une clarté particulière : la construction et la santé.

Ces secteurs partagent plusieurs caractéristiques : forte intensité de main-d’œuvre, faible niveau de numérisation historique, pression réglementaire croissante, et coûts d’erreur élevés. En construction, une malfaçon ou un retard de chantier se traduit directement en pertes financières et en litiges. En santé, une erreur de dosage, un diagnostic manqué, ou un dossier mal documenté a des conséquences sur des vies et sur des budgets déjà sous tension.

Dans ces 2 secteurs, quand l’énergie, le capital et la main-d’œuvre coûtent plus cher, on est prêt à payer davantage pour mieux décider, mieux planifier, mieux documenter, éviter la non-qualité, et réduire le temps improductif. L’IA n’est pas ici un accélérateur de croissance mais plutôt un réducteur d’exposition. Et c’est précisément pour cette raison qu’elle y devient défendable dans un monde contraint.

Dans le BTP, prenons l’exemple d’un système qui détecte un écart de conformité avant le coulage du béton. La valeur de ce système ne tient pas à la croissance de l’entreprise, elle tient à la contrainte. D’un côté, parce que le béton et ses composants coûtent chers : une malfaçon à corriger après coulage représente un coût directement indexé sur les matières premières. De l’autre, parce que l’expert qui aurait détecté cet écart manuellement est de moins en moins disponible sur les chantiers. Ce système vaut davantage quand le monde se contracte, pas quand il croit. C’est précisément le critère d’un investissement défendable.

L’impact attendu est direct et mesurable : moins de temps perdu sur des tâches administratives à faible valeur, moins d’erreurs de planification ou de conformité, moins de matière gâchée, moins de dépendance à quelques profils experts que le marché ne peut plus fournir en nombre suffisant.

Ce que ça change pour la décision d’investissement

Le discours sur l’IA restera dominé par les promesses de croissance encore quelque temps. Mais les organisations qui investissent dans ce cadre-là font un pari implicite : que le contexte macroéconomique restera favorable, que l’énergie redeviendra bon marché, que les chaînes d’approvisionnement se stabiliseront, que la géopolitique se calmera.

Pari somme toute ambitieux, sachant que le taux de dépendance de l’UE vis-à-vis des importations d’énergie est de 57%… (source : eurostat)

Les investissements IA les plus défendables ne sont pas ceux qui maximisent l’upside dans un scénario de croissance. Ce sont ceux qui réduisent l’exposition aux ruptures dans un scénario de contrainte et dont la valeur augmente, plutôt que de diminuer, quand les conditions se dégradent.

La question à se poser n’est pas : quelle IA va nous faire croître plus vite ? Mais plutôt : quelle IA va nous permettre de tenir, et même de nous renforcer, dans un monde où les ressources coûtent plus cher (naturelles, main d’œuvre, etc.) et les erreurs sont moins tolérables ?

Ce qui distingue ces investissements, c’est au fond un cercle vertueux. L’expert rare possède un savoir-faire que le marché ne peut pas reproduire à l’échelle. Un produit IA bien conçu capte, structure et démultiplie ce savoir-faire en le rendant accessible.

Les individus qui travaillent avec ce produit montent en compétence, contribuent à son amélioration, et renforcent l’actif organisationnel. Ce cycle (savoir-faire → IA → individu → savoir-faire enrichi) produit quelque chose de rare dans un monde contraint : un avantage compétitif qui se renforce quand les conditions se dégradent, parce qu’il est ancré dans la connaissance propre de l’organisation. C’est ce cercle vertueux que nous construisons à La Forge.

(Et ça vous évitera peut-être un réveil forcé pour profiter des heures creuses…)